Zoltan Istvan نویسندهی رمان فلسفی The Transhumanist Wager، مؤسس و کاندیدای ریاست جمهوری حزب Transhumanist و آیندهپژوه است. او گاه و بیگاه ستونی را در سایت Motherboard دربارهی آیندهی انسان با تواناییهای فرا طبیعی مینویسد. نوشتهی زیر ترجمهای یکی از نوشتهی او در همین سایت است. لازم به ذکر است که بخشهایی از این نوشته حذف شده اما متن کامل آن را میتوانید در اینجا بخوانید.

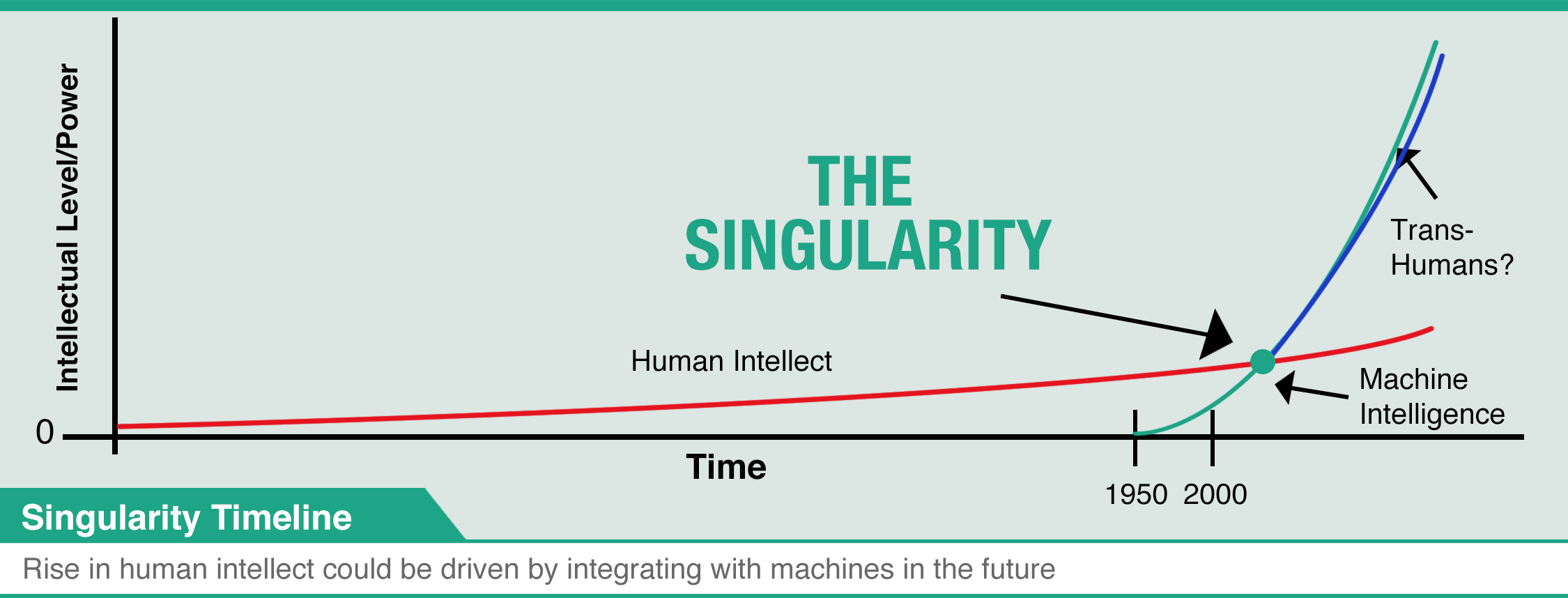

مفهوم تکنولوژیک تکینگی فناوری و یا همان singularity مسئلهی آسانی برای درک کردن نیست. حتی متخصصان هم تعاریف مختلفی از این موضوع دارند. Vernor Vinge گسترشدهندهی این ایده در دههی ١٩٩٠ معتقد است که بهزودی فراهوش، مدلهای فهم انسانی را بهکلی منسوخ خواهد کرد.

Ray Kurzweil از شرکت گوگل در این باره میگوید:

در دورهای از آیندهی نزدیک سرعت پیشرفت و تغییر تکنولوژی در حدی سریع خواهد بود که تأثیرات عمیق آن زندگی انسان را بهطور غیرقابل برگشتی دچار دگرگونی خواهد کرد.

و یا سردبیر مجله Wired که معتقد است:

تکینگی فناوری نقطهای است که تمامی تغییرات جهان در چند میلیون سال گذاشته معادل با تغییرات جهان در چند دقیقهی آینده خواهد بود.

اما تعریف من از تکینگی فناوری این است:

مرحلهای که ذهنِ در حال فعالیت یک انسان، هوش و قابلیتهای خود را بهطور ریشهای توسط ادغام فیزیکی با تکنولوژی افزایش دهد.

تمامی این تعاریف در یک اصل ساده مشترک هستند: تکنولوژی جهش هوش انسان را تا حدی سرعت خواهد بخشید که درک و فهم بیولوژیک انسان برای دریافتن آنچه در حال وقوع است کافی نخواهد بود. بهعلاوه این جهش باعث خواهد شد که تکینگی فناوری مفهومی شبه معنوی باشد. چراکه هر چیزی فراتر از درک طبیعی انسان یک موضوع ماورایی و رازآلود است. توجه به این نکته ارزشمند است که حتی بیشتر افرادی که با ظهور مفهوم تکینگی فناوری مخالف هستند و یا حتی آن را غیرممکن میدانند نیز شکی ندارند که بشر برای دستیابی به آن در حال رقابت است.

در مارس سال ٢٠١٥، من مقالهای با عنوان A Global Arms Race to Create a Superintelligent AI is Looming در سایت Motherboard منتشر کردم و در آن به بحث دربارهی موضوعی پرداختم که آن را هوش مصنوعی ضروری (the AI Imperative) مینامم. به عقیدهی من هر کشوری باید تمام تلاش خود را برای توسعهی هوش مصنوعی بکند، چراکه هر کشوری که قبل از همه یک هوش مصنوعی بینقص تولید کند، به این دلیل که خواهد توانست تمام تکنولوژیها و توسعهی آنها را کنترل کند، بهطور نامحدود برجهان حکمرانی خواهد کرد.

این مقاله نظرات قابلتوجه زیادی را در Reddit Futurology، LessWrong و چند جای دیگر از سوی خوانندگان گرفت. من ترجیح میدهم برای نوشتهی خود نظری ننویسم ولی همیشه بخش نظرات را با دقت میخوانم، آنچه در بخش نظرات برای من قابل تأمل بود امکان رخداد تکینگی ملیگرایانه بود که میتوان آن را یک تکینگی فناوری انحصاری یا خصوصی نیز نامید.

اگر شما نیز مثل من از عاشقان تکنولوژی باشید، احتمالاً باور دارید که کلید دستیابی به تکینگی فناوری دو چیز است:

تولید یک فراهوش مصنوعی و توانایی ادغام انسان با این هوش. دستیابی به تکینگی فناوری بدون این دو ناممکن و با داشتن هردو اجتنابناپذیر است. در حال حاضر امکان ادغام مغز انسان با ماشین در شرف وقوع است. بهعنوانمثال در سال گذشته telepathy بین دو محقق در کشورهای مختلف انجام شد و افکار با استفاده از رابط ماشینی از مغز یک فرد به مغز دیگری بدون گفتن کلمهای انتقال یافتند.

در طی ٢٥ سال آینده و به اعتقاد برخی دیگر چون Kurzweil حتی شاید بسیار زودتر، انسان قادر خواهد بود تمام آگاهی خود را روی یک ماشین بارگذاری کند. ازنظر من هم ما در طی ١٥تا ٢٠ سال آینده شاهد ظهور تکینگی فناوری خواهیم بود.

اما مسئلهی دشوار اینجاست: اگر هوش مصنوعی بهطور انحصاری در اختیار یک کشور باشد و تکنولوژی ادغام مغز انسان با ماشین هم بهخوبی پیشرفت کند، بهاحتمالزیاد با یک کشور واحد که در حال کنترل همهی مسیرها بهسوی تکینگی فناوری است مواجه خواهیم شد.

همان اندازه که این امر غیرقابلباور به نظر میرسد، ممکن است که کشور کنترلکننده به شهروندانش شانس این را بدهد که خود را بهطور کامل روی یک ماشین -روی تکینگی فناوری- بارگذاری کنند. در این صورت با دو موجودیت جدا از هم مواجه خواهیم بود: یک موجودیت بیولوژیک و یک موجودیت بارگذاری شده. در این صورت پس از انجام این کار، آیا نسخهی دیجیتالی هر فرد قادر به برقراری ارتباط با نسخهی طبیعی خود خواهد بود؟ آیا این نسخهها خواهند توانست به یکدیگر کمک کنند؟ آیا ممکن است قانون، افراد را مجبور به نگهداری نسخهی بیولوژیک خود بهصورت منجمد شده کند؟ آیا ممکن است نسخهی بیولوژیک انسانها بهطورکلی حذف شود؟

نوع نگاه به این مسئله مهم نیست. این موضوع یک مورد آیندهپژوهی عجیب و شاید ترسناک است که پیامدهای اخلاقی و چالش برانگیز فراوانی خواهد داشت. برخی از تکنولوژیستها، کنترل شدن تکینگی فناوری توسط یک کشور و یا حتی انحصاری کردن آن برای مردم یک کشور را ازنظر اخلاقی موضوعی مشکوک میدانند.

برای مثال، تصور کنید چه اتفاقی میافتد اگر آمریکا قبل از بقیهی کشورها، بتواند فراهوشی بسازد که به تکینگی فناوری دست یابد؟ و یا بدتر اینکه چه اتفاقی میافتد اگر دولتی تصمیم بگیرد، فراهوش را فقط در اختیار اقشار مرفه جامعه و یا فقط نمایندگان مجلساش قرار دهد؟ اشخاصی مانند پوتین چگونه با چنین قدرتی رفتار خواهند کرد؟ قطعا دستیابی به تکینگی فناوری قدرت کوچکی نیست، بشر با دستیابی به فراهوش قادر خواهد بود به سادگی تمام کدهای سلاحهای هستهای را در جهان از نو بنویسید، سدها و نیروگاهها را متوقف سازد و درصورتیکه بخواهد ویروسی بسازد که تمام شبکههای Wi-Fi در جهان را از کار بیندازد.

مطمئناً درصورتیکه افراد حق انتخاب داشته باشند، بسیاری از آنها استفاده از تکینگی فناوری را برنخواهند گزید. بااینحال شاید عدهای از همان مردم برای فروش آن به دنبال دستیابی به این تکنولوژی باشند. همچنین افراد و سازمانهای مختلف ممکن است درصدد پتنت کردن آن برآیند.

اولین گروه یا فردی که به این تکنولوژی دست یابد از قدرت و هوشی که در فرآیند تکینگی فناوری به دست آورده است بهشدت محافظت خواهد کرد. این بدان معناست که آنها هرچه را که نیاز است انجام خواهند داد تا قدرت و هوشمندی گردآوریشده از تجربهی تکینگی فناوری توسط دیگران را به حداقل برسانند.

در رمان فلسفی من، The Transhumanist Wagerِ؛ چنین تفکری متعلق به شخصیت Omnipotender است. فردی که با جدیت برای داشتن بیشترین قدرت ممکن تلاش میکند. من دربارهی خوب یا بد بودن، اخلاقی یا غیراخلاقی بودن هیچیک از اینها بحث نمیکنم. من تنها در حال توضیح دادن این هستم که پدیدهی تکینگی فناوری چگونه ممکن است ظاهر شود. با فرض اینکه پیشبینیهای من درست باشند و تکنولوژی با همین سرعت رشد کند، Omnipotender واقعی در حال حاضر متولد شده است.

تکینگی فناوری یک پدیدهی تقریباً بدون هوشیاری خواهد بود. همهی ما تقریباً دیجیتالی و پیوسته به ماشینها خواهیم بود، ولی کماکان قادر به تشخیص خودمان، یادآوری خاطرهها، اهداف و ارزشهایمان خواهیم بود. من انتظار دارم نرمافزار مغزمان بهصورت آنی و بلادرنگ (real time) دارای قابلیت از نو نویسی و بهبود امکانات باشد. بهعلاوه فکر میکنم سختافزاری که به آن متصل خواهیم بود قابلیت شکلگیری دوباره داشته باشد و بتوانیم بهصورت بلادرنگ آن را بسازیم. ما یاد خواهیم گرفت چگونه به هنگام نیاز و بدون تأخیر پردازشگرها و خردهریزههایشان را دوباره سوار کنیم و همهی اینها احتمالاً بهسرعت و چابکی فکر کردن به یک موضوع، مثلاً حل کردن یک مسئلهی ساده ریاضی، انجام خواهد گرفت. ما خواهیم توانست قواعد را درک کنیم و دربارهی آنچه میخواهیم فکر کنیم. قادر خواهیم بود بهترین جواب، بهترین استراتژی یا بهترین مسیر را بیابیم. در چنین مسائلی به بالاترین حد کارایی خواهیم رسید و در برخی موارد تفاوتی بین مسائل مختلف انرژی، قضاوت و خودمان نخواهیم یافت.

شاید در این میان مهمترین نکته این است که ما دیگر اهمیت چندانی به آنچه در زمین باقیمانده نخواهیم داد. در چند روز یا حتی چند ساعت تکینگی فناوری شکلی از انرژی برایمان خواهد ساخت که میتواند بهطور بسیار هوشمندانهای خود را سازماندهی کرده و پیشرفت کند. شاید بر روی تریلیونها مغز، روی میلیونها زمین.

اگر تکینگی فناوری اینچنین رخ دهد، تکینگی فناوری خصوصی و ملی تنها اندکی در مسائل اخلاقی با مشکل روبرو خواهد شد، چراکه کشورها و گروههای دیگر خواهند توانست نسخهی خود را پیادهسازی کرده و گسترش دهند. حال بحث اصلی بر سر این موضوع است: مردم چگونه از خود در برابر فرد یا گروههایی که تصمیم میگیرند زمین و ساکنین آن ارزش ادامهی حیات ندارند، یا حتی میخواهند همگان را درروی زمین به اسارت بگیرند، محافظت خواهند کرد؟

پاسخ روشنی برای این مسئله وجود ندارد؛ اما این سؤال باعث میشود من دربارهی ایدهی singularity نظر چندان خوبی نداشته باشم. من موجودیت یا گروهی با این حد از قدرت و تسلط بر سایر موجودات را دوست ندارم.

وحید یوسفیان

وحید یوسفیان